지난 주요뉴스 한국경제TV에서 선정한 지난 주요뉴스 뉴스썸 한국경제TV 웹사이트에서 접속자들이 많이 본 뉴스 한국경제TV 기사만 onoff

-

'AI 추경' 2조원…첨단 GPU 1만장 산다 2025-05-02 17:51:40

도입하는 GPU는 엔비디아의 H200과 블랙웰 등 최신 모델이다. 국가AI컴퓨팅센터가 문을 여는 오는 11월 이전에는 민간 클라우드 기업의 GPU 2600개를 빌려 쓸 수 있도록 예산 1723억원을 따로 배정했다. 생성형 AI의 근간인 차세대 대규모언어모델(LLM)을 개발할 ‘월드 베스트 대규모언어모델(WBL)’ 프로젝트에 참여할...

- 뉴스 > IT·과학

- 바로가기

-

엔비디아 AI칩 구입·산불 진화 도로 두배 확충…12.2조 '필수 추경' 확정 2025-04-18 17:35:58

H200, 블랙웰 등 엔비디아의 최신 그래픽처리장치(GPU) 1만 장을 1조5000억원에 사들이기로 했다. 정부는 이번 추경으로 올해 경제성장률이 0.1%포인트가량 상승할 것으로 추산했다. 추경 재원은 내부 자금으로 4조1000억원을 충당한다. 나머지 8조1000억원은 적자국채를 찍어 조달한다. 국채를 추가 발행하는 만큼 올해 말...

- 뉴스 > 경제

- 바로가기

-

통상·AI에 4.4조 투입..."GPU 1만장 확보" 2025-04-18 14:44:01

엔비디아의 최신 GPU 'H200'와 차세대 버전인 'B200' 등을 포함해 모두 1만장의 GPU를 선구매한다는 계획입니다. 앞서 유상임 과학기술통신부 장관은 "추경이 조속히 편성되지 않으면 올 한해 GPU가 들어오지 못하는 '보릿고개'가 될 수 있다"고 우려했는데요. 국가AI컴퓨팅 사업이 난항을 겪을...

- 뉴스 > 경제

- 바로가기

-

[2025추경] GPU 1만장에 1.5조 '실탄'…국가대표 AI팀 밀어준다 2025-04-18 11:00:16

◇ 1.5조원 들여 연내 H200·블랙웰 1만장 분 들인다 과학기술정보통신부는 추경 예산 1조4천600억원을 투입해 올해 11월부터 서비스를 개시하는 '국가 AI 컴퓨팅 센터'에 첨단 그래픽처리장치(GPU) 1만장분을 연내 우선 도입한다고 밝혔다. 과기정통부 관계자는 "국가 AI 컴퓨팅 센터 참여 기업이 어떤 GPU 모델을...

- 뉴스 > 경제

- 바로가기

-

"中 상장사 쫓아낼 것"…시진핑 전방위로 옥죄는 트럼프 2025-04-16 17:52:23

중국 기술기업은 최첨단 H200 칩에 비해 사양이 떨어지는 H20 칩을 이용해 AI 모델을 훈련하고 있다. 블룸버그통신에 따르면 바이든 행정부는 H20 수출을 통제하면 중국에서 AI 모델을 개발하는 비용이 약 3~6% 증가한다고 추산했다. 엔비디아는 120억달러(약 17조원) 규모 손실을 볼 것으로 전망된다. H20 칩 수출 통제가...

- 뉴스 > 정치

- 바로가기

-

엔비디아, 수출 통제로 8조 날려…삼성·SK도 영향권 2025-04-16 14:41:51

엔비디아는 H100과 H200, 블랙웰 등 고성능 인공지능 칩을 보유하고 있는데, H20은 합법적으로 중국에 공급할 수 있는 최대 사양의 칩입니다. 이 때문에 중국은 인공지능 개발에 주로 H20을 활용했고, 올해 초 전 세계를 놀라게 한 중국의 스타트업 딥시크도 H20을 사용한 것으로 알려졌습니다. 트럼프 행정부가 들어서자...

- 뉴스 > 산업

- 바로가기

-

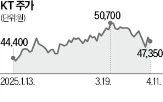

KT, 최신 GPU 도입한다…불붙은 'AX 경쟁' 2025-04-13 17:19:03

H100을 사용하고 있다. 오는 3분기에는 H200을 적용할 예정이다. 이후 H 시리즈 후속 제품인 블랙웰을 도입해 AX 사업의 경쟁력을 키울 것으로 예상된다. 블랙웰은 대규모언어모델(LLM)을 처리할 때 H100보다 추론 속도가 최대 약 4~5배 빠른 것으로 알려졌다. KT는 올해 하반기 2개 인공지능(AI) 데이터센터를 추가 개소해...

- 뉴스 > IT·과학

- 바로가기

-

SKT 이어 KT도…엔비디아 최신 GPU '블랙웰' 도입한다 2025-04-13 14:20:57

GPUaaS 서비스에 엔비디아 H100을 사용하고 있다. 오는 3분기에는 H200을 적용할 예정이다. 이후 H 시리즈의 후속 제품인 블랙웰을 도입하며 AX 사업의 경쟁력을 키울 전망이다. 블랙웰은 거대언어모델(LLM)을 처리할 때 H100보다 추론 속도가 최대 약 4~5배 빠른 것으로 알려졌다. KT는 올해 하반기 2개 AI 데이터센터를 ...

- 뉴스 > IT·과학

- 바로가기

-

SKT 이어 KT도 엔비디아 '블랙웰' 도입 검토…AX 사업 기반 강화 2025-04-13 06:00:06

사업을 더욱 강력하게 뒷받침할 전망이다. H200은 거대 언어 모델(LLM)을 처리할 때 H100보다 추론 속도가 최대 2배 빠르고 블랙웰은 H100보다 약 4~5배 빠르다고 알려졌다. KT는 현재 H100을 8천장 이상 보유하고 있다. H200의 도입 규모는 알려지지 않았다. 아울러 KT는 올해 하반기 2개 AI 데이터센터(AI DC)를 추가로...

- 뉴스 > 경제

- 바로가기

-

"수백 대 GPU 서버 효율적 관리…최적의 AI 연구개발 환경 만든다" [긱스] 2025-04-08 18:29:51

수밖에 없다. 엔비디아의 H200 같은 GPU는 장당 가격이 수천만원에 이른다. 수백 대의 GPU 서버를 얼마나 효율적으로 배분하는지에 따라 개발 속도는 물론 비용까지 달라진다. GPU 서버를 보유한 기업 모두가 겪는 어려움이다. 래블업은 이 같은 문제를 해결하기 위해 플랫폼 ‘백엔드닷에이아이(Backend.AI)’를 개발했다....

- 뉴스 > IT·과학

- 바로가기